Merge pull request #62 from joey12300/release/v0.1.0

update linux_build.md and CMakeLists.txt

Showing

inference/docs/demo.jpg

0 → 100644

2.2 MB

inference/docs/demo_jpg.png

0 → 100644

23.3 KB

inference/docs/vis.md

0 → 100644

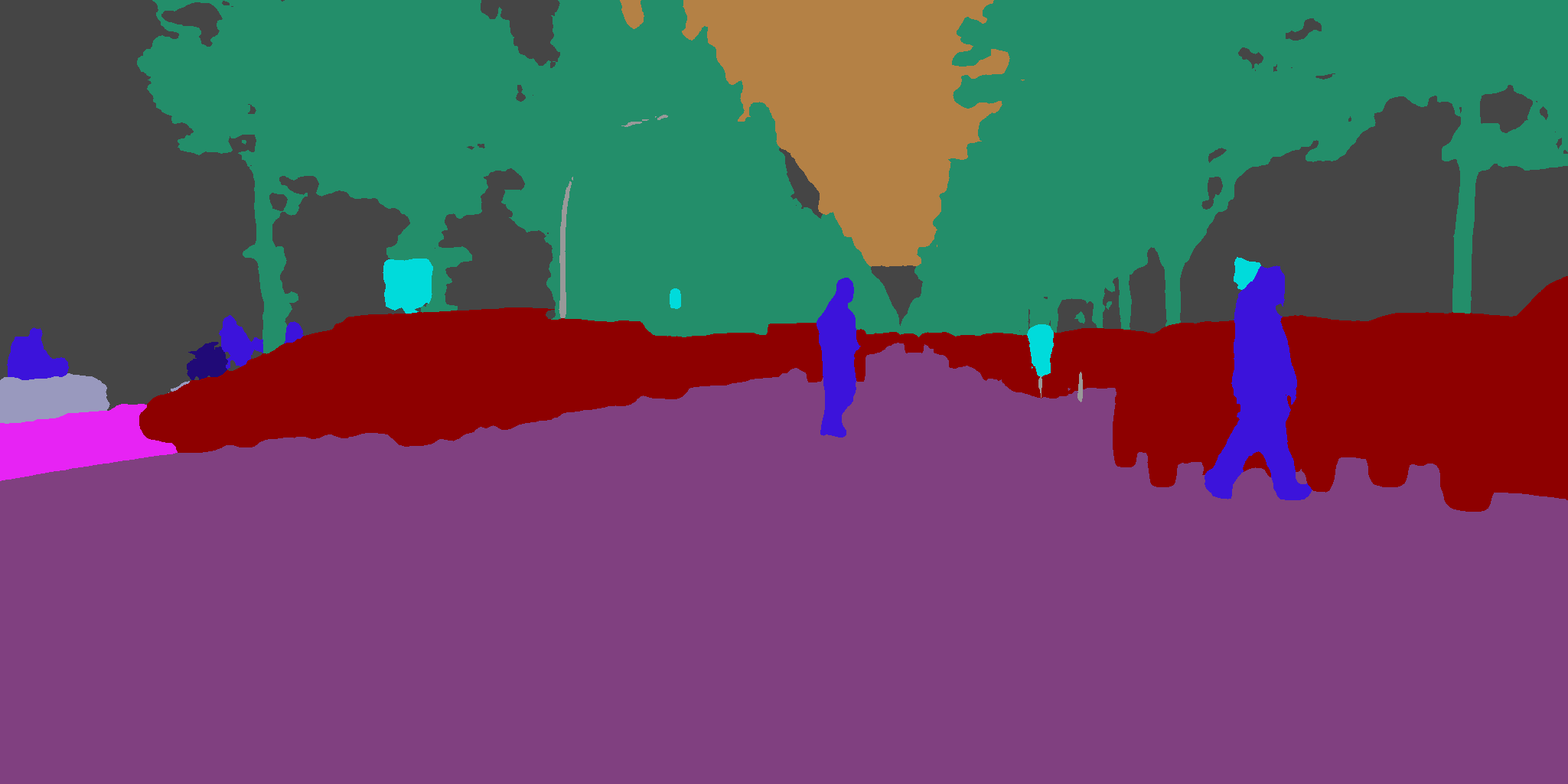

inference/docs/vis_result.png

0 → 100644

50.5 KB